Seit ihrer Einführung vor einigen Jahren autonome Fahrzeuge haben sich langsam in immer größerer Zahl auf den Weg gemacht, aber die Öffentlichkeit bleibt trotz der unbestreitbaren Sicherheitsvorteile, die sie der Öffentlichkeit bieten, vorsichtig mit ihnen.

Autonome Fahrzeughersteller sind sich dessen voll bewusst Skepsis der Öffentlichkeit . Jeder Absturz macht es schwieriger, öffentliches Vertrauen zu gewinnen, und es besteht die Befürchtung, dass Unternehmen die Autonomie nicht verwalten. Fahrzeugausführung Richtig, das Spiel könnte die Tür der selbstfahrenden Autotechnik so schließen wie Three Mile Island Unfall herunterfahren das Wachstum von Kernkraftwerken in den Vereinigten Staaten in den 1970er Jahren.

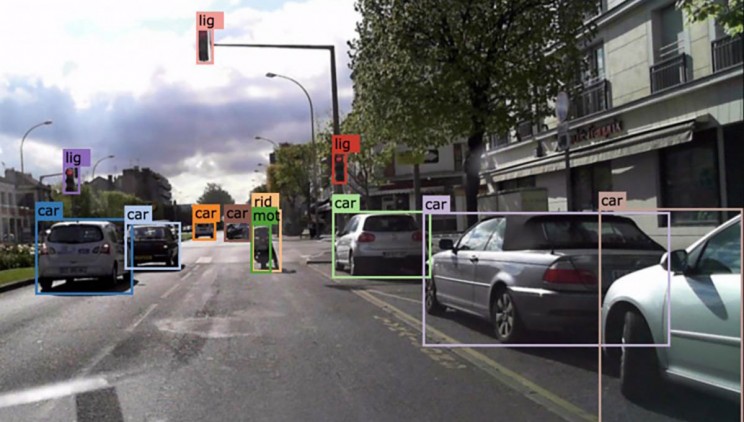

Herstellung autonome Fahrzeuge Sicherer als sie bereits sind bedeutet, diejenigen Fälle zu identifizieren, an die Programmierer möglicherweise nie gedacht haben und auf die die KI nicht angemessen reagiert, die ein menschlicher Fahrer jedoch intuitiv als potenziell gefährliche Situation versteht. Neue Forschung Aufgrund einer gemeinsamen Anstrengung von MIT und Microsoft kann diese Lücke zwischen maschinellem Lernen und menschlicher Intuition geschlossen werden, um die bisher sichersten autonomen Fahrzeuge herzustellen.

Beruhigung einer vorsichtigen Öffentlichkeit

Wäre öffentliches Zögern kein Faktor, würde jedes Auto auf der Straße innerhalb weniger Jahre durch ein autonomes Fahrzeug ersetzt. Jeder LKW wäre inzwischen vollständig autonom und es gäbe keine Uber- oder Lyft-Fahrer, nur Shuttle-Taxis, die Siewürde telefonisch bestellen und es würde in ein paar Minuten reibungslos zum Bordstein fahren, ohne dass ein Fahrer in Sicht wäre.

Unfälle würden passieren und Menschen würden immer noch sterben, aber durch einige Schätzungen 90% der Verkehrstoten auf der ganzen Welt könnten mit verhindert werden autonome Fahrzeuge . Autonome Autos müssen möglicherweise aufgeladen werden, müssen jedoch nicht schlafen, keine Pausen einlegen und sind entschlossen, die Anweisungen in ihrer Programmierung auszuführen.

Für Unternehmen, die auf den Transport angewiesen sind, um Waren und Personen von Punkt A nach Punkt B zu bringen, spart das Ersetzen von Fahrern durch selbstfahrende Autos Arbeits-, Versicherungs- und andere Nebenkosten, die mit einer großen Anzahl menschlicher Mitarbeiter verbunden sind.

Die Kosteneinsparungen und die Sicherheitsgewinne sind einfach zu groß, um Menschen auf der Straße und hinter dem Lenkrad zu halten.

Wir schlafen ein, wir fahren betrunken, wir werden abgelenkt oder wir fahren einfach schlecht und die Folgen sind sowohl kostspielig als auch tödlich. Etwas mehr als eine Million Menschen sterben jedes Jahr auf den Straßen auf der ganzen Welt und allein durch die Umstellung auf autonome Nutzfahrzeuge könnten die Transportkosten gesenkt werden einige Unternehmen in zwei Hälften

Dennoch ist die Öffentlichkeit nicht überzeugt und sie werden skeptischer mit jeder Meldung eines Unfalls mit a selbstfahrendes Auto .

Edge Cases: Die Achillesferse selbstfahrender Autos?

Ob fair oder nicht, die Verantwortung für den Nachweis einer autonomen Fahrzeugsicherheit liegt bei denjenigen, die sich für selbstfahrende Fahrzeugtechnologie einsetzen. Dazu müssen Unternehmen daran arbeiten, die Randfälle zu identifizieren und anzugehen, die zu Unfällen mit hohem Bekanntheitsgrad führen könnendas Vertrauen der Öffentlichkeit in die ansonsten sichere Technologie verringern.

Was passiert, wenn ein Fahrzeug die Straße hinunterfährt und ein wettergegerbtes, verbogenes, unförmiges und verblasstes Stoppschild entdeckt? Obwohl dies offensichtlich selten vorkommt, hätten die Transportabteilungen ein solches Schild wahrscheinlich schon lange zuvor entferntschrecklicher Zustand - Randfälle sind genau diese Art von Situation.

Ein Randfall ist ein Ereignis mit geringer Wahrscheinlichkeit, das nicht auftreten sollte, aber in der realen Welt auftritt, genau die Fälle, die Programmierer und maschinelle Lernprozesse möglicherweise nicht berücksichtigen.

In einem realen Szenario erkennt das autonome Fahrzeug möglicherweise das Schild und hat keine Ahnung, dass es sich um ein Stoppschild handelt. Es behandelt es nicht als solches und kann beschließen, die Kreuzung mit Geschwindigkeit zu überqueren und einen Unfall zu verursachen.

Ein menschlicher Fahrer kann es auch schwer haben, das Stoppschild zu identifizieren, aber das ist für erfahrene Fahrer viel weniger wahrscheinlich. Wir wissen, was ein Stoppschild ist, und wenn es sich in etwas anderem als vollständigem Ruin befindet, werden wir wissen, dass wir anhalten müssendie Kreuzung, anstatt sie zu durchlaufen.

Genau diese Situation haben Forscher am MIT und Microsoft gemeinsam ermittelt und gelöst, um die Sicherheit autonomer Fahrzeuge zu verbessern und hoffentlich die Art von Unfällen zu verringern, die die Einführung autonomer Fahrzeuge auf unseren Straßen verlangsamen oder verhindern könnten.

Modellierung am Rand

In zwei Beiträgen, die auf der letztjährigen Konferenz Autonomous Agents and Multiagent Systems und der bevorstehenden Konferenz der Association for the Advancement of Artificial Intelligence vorgestellt wurden, haben die Forscher erklären ein neues Modell für das Training autonomer Systeme wie selbstfahrender Autos, die menschliche Eingaben verwenden, um diese „blinden Flecken“ in KI-Systemen zu identifizieren und zu beheben.

Die Forscher führen die KI durch simulierte Trainingsübungen, wie sie herkömmliche Systeme durchlaufen. In diesem Fall beobachtet ein Mensch die Aktionen der Maschine und erkennt, wann die Maschine einen Fehler machen wird oder gemacht hat.

Die Forscher nehmen dann die Trainingsdaten der Maschine und synthetisieren sie mit dem Feedback des menschlichen Beobachters und führen sie durch ein maschinelles Lernsystem. Dieses System erstellt dann ein Modell, mit dem Forscher Situationen identifizieren können, in denen der KI kritische Informationen fehlenwie es sich verhalten soll, besonders in Randfällen.

„Das Modell hilft autonomen Systemen, besser zu wissen, was sie nicht wissen“ entsprechend an Ramya Ramakrishnan, Doktorandin im Labor für Informatik und künstliche Intelligenz am MIT und Hauptautorin der Studie.

„Wenn diese Systeme eingesetzt werden, stimmen ihre trainierten Simulationen häufig nicht mit der realen Umgebung überein [und] sie können Fehler machen, z. B. bei Unfällen. Die Idee ist, Menschen zu verwenden, um diese Lücke zwischen den Simulationen zu schließenund die reale Welt auf sichere Weise, damit wir einige dieser Fehler reduzieren können. “

Das Problem tritt auf, wenn eine Situation auftritt, z. B. das verzerrte Stoppschild, in dem die meisten Fälle, in denen die KI trainiert wurde, nicht den realen Zustand widerspiegeln, für dessen Erkennung sie hätte trainiert werden müssen. In diesem Fall ist dies der Fallwurde geschult, dass Stoppschilder eine bestimmte Form, Farbe usw. haben. Es hätte sogar eine Liste von Formen erstellen können, die Stoppschilder sein könnten und wissen würden, für diese anzuhalten, aber wenn es ein Stoppschild nicht richtig identifizieren kann, könnte die Situationin einer Katastrophe enden.

„[B] Da inakzeptable Aktionen weitaus seltener sind als akzeptable Aktionen, wird das System schließlich lernen, alle Situationen als sicher vorherzusagen, was äußerst gefährlich sein kann.“ sagt Ramakrishnan.

Erfüllung der höchsten Sicherheitsstandards

Indem Forschern gezeigt wird, wo die KI unvollständige Daten enthält, können autonome Systeme an den Rändern sicherer gemacht werden, an denen hochkarätige Unfälle auftreten können. Wenn sie dies tun können, können wir den Punkt erreichen, an dem das Vertrauen der Öffentlichkeit in autonome Systeme zunehmen kannDie Einführung autonomer Fahrzeuge kann ernsthaft beginnen, was uns alle sicherer macht.