Ihre Chance, ein lustiges Gesicht vor eine Webcam oder eine Smartphone-Kamera zu ziehen, ist gekommen, und wir sprechen nicht über den regulären Familien-Zoom-Anruf oder den Social-Media-Beitrag.

Wissenschaftler der University of Cambridge und des University College London in Großbritannien haben eine Website erstellt, die die Diskussion um die Technologie zur Erkennung von Emotionen anregen und auf deren Risiken hinweisen soll.

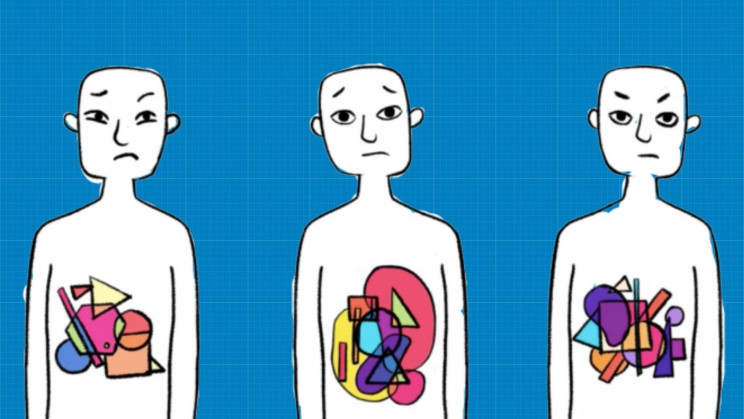

Ihre Website, Emojify genannt wurde entwickelt, um Menschen zu helfen, zu verstehen, wie Computer verwendet werden können, um die Gesichter von Menschen zu scannen, um ihre Emotionen zu erraten - etwas, das als Erkennung von Emotionen mit künstlicher Intelligenz bezeichnet wird.

Die Forscher wiesen darauf hin, dass diese Art von Technologie wird bereits in Teilen der Welt verwendet, beispielsweise während eines Vorstellungsgesprächs, um die Begeisterung eines Bewerbers für die Stelle festzustellen, oder während eines Gerichtsverfahrens, um die Unschuld oder Schuld einer Person festzustellen.

Einige könnten sagen, dass es verwendet wird, um einige ziemlich wichtige Lebensentscheidungen zu treffen, und die Frage muss gestellt werden: Ist das ethisch richtig? Genau darüber versucht das Forschungsteam, die Leute zum Reden zu bringen.

Funktionsweise der Emojify-Website

Auf seiner Website hat das Team ein Spiel eingerichtet, bei dem der Benutzer aufgefordert wird, eine Reihe von Gesichtern in die Kamera zu ziehen, um dann sechs menschliche Emotionen zu erraten: Glück, Traurigkeit, Angst, Überraschung, Ekel und Wut.

Es gibt auch einige Fragen, die der Benutzer beantworten kann, z. B. ob er diese Art von Technologie bereits verwendet hat, ob er sie für nützlich hält, sich Sorgen macht oder ob er überhaupt davon gehört hat.

Keines dieser Bilder oder Daten wird gespeichert, und die Hoffnung besteht darin, die Konversation über die umstrittene Technologie zu fördern.

Als Projektleiterin und Forscherin am Leverhulme-Zentrum für die Zukunft der Intelligenz der Universität Cambridge, Dr. Alexa Hagerty erzählt Indy500 , "Viele Menschen sind überrascht zu erfahren, dass die Technologie zur Erkennung von Emotionen existiert und bereits verwendet wird."

"Unser Projekt gibt den Menschen die Möglichkeit, diese Systeme selbst zu erleben und eine bessere Vorstellung davon zu bekommen, wie leistungsfähig sie sind, aber auch wie fehlerhaft", fuhr sie fort.

Wie auch Dr. Hagerty darauf hingewiesen Der Wächter Einige der Hauptsorgen im Zusammenhang mit dieser Technologie sind, dass sie ein großes Potenzial für Diskriminierung und Überwachung bietet. Darüber hinaus stellt das Team die Frage, wie Technologie die Emotionen von Menschen durch Gesichtsbewegungen genau erraten kann. Zum Beispiel lächeln wir manchmal, um höflich zu sein, nichtweil wir glücklich sind.

Das Team hat sich daher zum Ziel gesetzt, die Meinung der Öffentlichkeit zu sammeln und die Debatte unter denjenigen von uns zu beginnen, deren Gesichter ohne unser Wissen gescannt werden.