Human Resourcing für künstliche Intelligenz KI Werkzeuge sind im Moment der letzte Schrei und werden immer häufiger beliebt . Die Systeme können die Kosten des Einstellungsprozesses beschleunigen, vereinfachen und sogar senken, sodass der Traum eines jeden Personalvermittlers wahr wird.

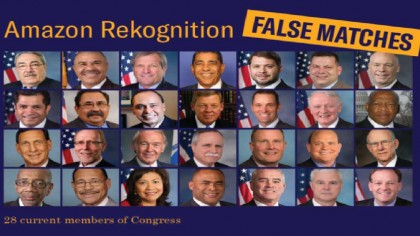

Wie wir bereits gesehen haben, können KI-Systeme manchmal auch potenziell gefährlich sein. voreingenommen Tendenzen. Letzten Juli, n On-Profit-Wachhund der American Civil Liberties Union von Nordkalifornien war schockiert, Fehler bei Amazon zu finden Gesichtserkennungstechnologie namens Rekognition, die möglicherweise zu rassistisch bedingten falschen Identifikationen führen kann.

Die Entdeckung führte zu öffentlichem Aufschrei bezüglich des Systems. Allerdings Amazon verteidigt sein Programm und sagte, der Einsatz neuer Technologien könne nicht vereitelt werden, da einige "beschließen könnten, sie zu missbrauchen", was impliziert, dass Probleme mit der Erkennung mit dem Missbrauch von Benutzern zusammenhängen.

Sexistische KI verschrottet

Nun scheint es, als hätte sich ein anderes KI-Werkzeug, diesmal ein Personalwerkzeug, irgendwie selbst beigebracht, sexistisch zu sein. Laut a Bericht von Reuters Ein geheimes internes Projekt von Amazon, bei dem versucht wurde, mit KI Bewerbungen zu prüfen, musste ausrangiert werden, nachdem festgestellt wurde, dass weibliche Kandidaten herabgestuft wurden.

Die Experten für maschinelles Lernen von Amazon haben seit 2014 an Computerprogrammen gearbeitet, mit denen die Lebensläufe der Bewerber überprüft und sortiert werden können. Das System hat potenzielle Kandidatenbewertungen im Bereich von einem bis fünf Sternen vergeben.

„Jeder wollte diesen heiligen Gral“, sagte einer der Mitarbeiter des KI-Projekts. Reuters . "Sie wollten buchstäblich, dass es ein Motor ist, in dem ich Ihnen 100 Lebensläufe geben werde, er wird die Top 5 ausspucken und wir werden diese einstellen."

Bis 2015 stellten die Spezialisten jedoch fest, dass das System bei Softwareentwicklern und anderen technischen Positionen problematische geschlechtsspezifische Kandidatenentscheidungen traf. Das Problem trat nach Ansicht der Experten auf, weil der Überprüfungsprozess für Computermodelle aus früheren Einstellungen abgeleitet wurdeMuster über einen Zeitraum von 10 Jahren erreicht.

Sich selbst Sexismus beibringen

Und da in dieser Zeit die Tech-Industrie besonders von Männern dominiert wurde, trainierte sich das Modell versehentlich, männliche Kandidaten weiblichen vorzuziehen. Es trainierte sich im Wesentlichen selbst, sexistisch zu sein.

Das Programm wurde Berichten zufolge inzwischen ausrangiert, wodurch mögliche negative Folgen beseitigt wurden. Die Geschichte zeigt jedoch die Gefahren auf, sich bei der Erstellung neuer Modelle auf frühere Daten zu verlassen.

"Jeder Mensch auf dem Planeten ist voreingenommen. Wir alle tragen ein unheilbares Virus, das als unbewusste Voreingenommenheit bezeichnet wird. Ich bin fest davon überzeugt, dass KI die einzige Möglichkeit ist, die Voreingenommenheit des Menschen bei der Rekrutierung zu verringern. Leider ist die naive Verwendung von KI für die Rekrutierung ein garantiertes Rezeptfür eine Katastrophe. Rassistische / sexistische KI ist kein Risiko, sie ist eine Garantie, wenn sie von unerfahrenen Teams verwendet wird. KI wird natürlich unsere Vorurteile lernen und sie verstärken ", erklärte IE Chief AI Officer bei Ziff Ben Taylor.

Trotzdem sollte man das Baby nicht mit dem Badewasser wegwerfen. Es gibt Möglichkeiten, die Vorteile der KI ohne Vorurteile zu nutzen. "Es gibt viele Unternehmen außerhalb des Medienrampenlichts, die KI verantwortungsbewusst einsetzen und Millionen für negative Auswirkungen ausgegeben habenSchutz / Forschung, um so etwas zu verhindern ", fügte Taylor hinzu.

Von Erkennung von Krebs um Behandlungen zu machen weniger giftig Die Technologie scheint immer neue und sehr hilfreiche Anwendungen zu finden. Und bei Organisationen, die versuchen, potenziell unangenehme Probleme einzudämmen und zu zähmen. Ergebnisse Es ist eine gute Vermutung, dass KI, wenn sie richtig angenommen wird, eines der größten Vermögenswerte der Menschheit sein kann.

Wir müssen nur wachsam und bewusst bleiben. Gemessen an der schnellen Verfügbarkeit des frauenfeindlichen Rekrutierungswerkzeugs von Amazon scheinen wir auf dem richtigen Weg zu sein, unsere KI menschenfreundlich zu halten.