Die aktuelle Technologie kann die Augenbewegung bereits durch Verfolgen der Iris eines Benutzers abschätzen - was beispielsweise für Augmented-Reality-Headsets praktisch ist.

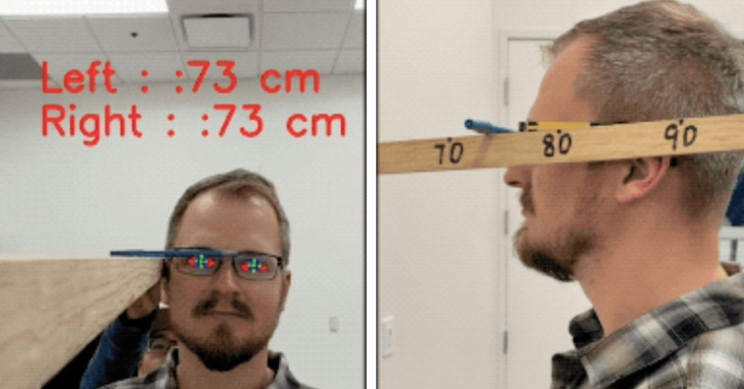

Google AI ist noch einen Schritt weiter gegangen, indem nicht nur gezeigt wurde, dass Irisverfolgung möglich ist, sondern auch die Entfernung zwischen Benutzer und Kamera möglich ist - auch ohne Verwendung eines speziellen Tiefensensors.

Dies wird sich für eine Vielzahl von nützlich erweisen KI-Technologien Dazu gehören Computerfotografie, virtuelle Brillen und Hüte sowie die automatische Änderung der Schriftgröße in Abhängigkeit von der Entfernung des Benutzers zum Gerät.

SIEHE AUCH: GOOGLE CEO RUFT FÜR AI-REGELUNG IN NEW EDITORIAL

Tricky Tracking

gemäß Blogbeitrag von Google AI Das Verfolgen von Irisbewegungen auf Mobilgeräten ist keine leichte Aufgabe. Denken Sie nur an die Zeiten, in denen Sonnenschein auf Ihr Gesicht fällt, wenn Sie auf Ihren Bildschirm blicken, oder wenn Sie blinzeln, um kleinere Schriften zu sehen, oder wenn Sie einen Strang habenvon Haaren im Weg. Daher wird normalerweise spezielle Hardware benötigt, um dies zu tun.

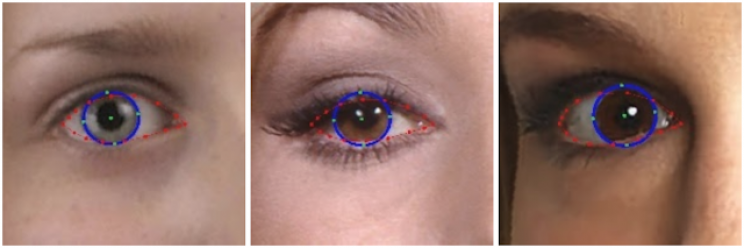

Enter, MediaPipe Iris , das neue maschinelle Lernmodell von Google AI, das die Bewegung und Entfernung der Iris schätzt.

MediaPipe benötigt keine spezielle Hardware und kann weiterhin Sehenswürdigkeiten von verfolgen. Iris Pupillen- und Augenkonturen bei Verwendung einer RGB-Kamera während der Echtzeitnutzung. Der relative Fehler liegt unter 10% .

Darüber hinaus kann MediaPipe auf den meisten Mobilgeräten, Laptops, Desktops und mehr ausgeführt werden.

Die Google AI-Team trainierte das Modell durch manuelles Annotieren 50.000 Bilder mit einer Reihe verschiedener Aspekte wie Beleuchtung, Kopfhaltungen, verschiedene Hintergründe usw. Das Team sammelte auch nach vorne gerichtete, synchronisierte Videos und Tiefenbilder von über 200 Teilnehmer um die Genauigkeit ihrer Methode sicherzustellen.