Ob Sie begeistert sind oder nicht, Roboter und künstliche Intelligenz sind ein unvermeidlicher Teil einer Zukunft, der wir uns schnell nähern. Dank Büchern und Filmen, die mit betrügerischen KIs und böswilligen Robotern übersät sind, sind manche Menschen verständlicherweise ein bisschen verängstigt durch die Aussicht auf eine Welt, die von solchen Technologien überrannt wird.

Sie sind nicht allein, da viele Experten aus so unterschiedlichen Bereichen wie Technologie und Wirtschaft auch ihre Befürchtungen über den Aufstieg der Roboter zum Ausdruck bringen. Obwohl diese Befürchtungen zweifellos zutreffen, ist es wichtig zu beachten, dass diese Bedenken in der EU geäußert werdenhofft, dass die Technologie verbessert und nicht verboten werden kann.

Hier sind nur einige der dringenden Bedenken in Bezug auf Roboter und AIs, die Experten vor Beginn der neuen Ära der Technologie ansprechen möchten.

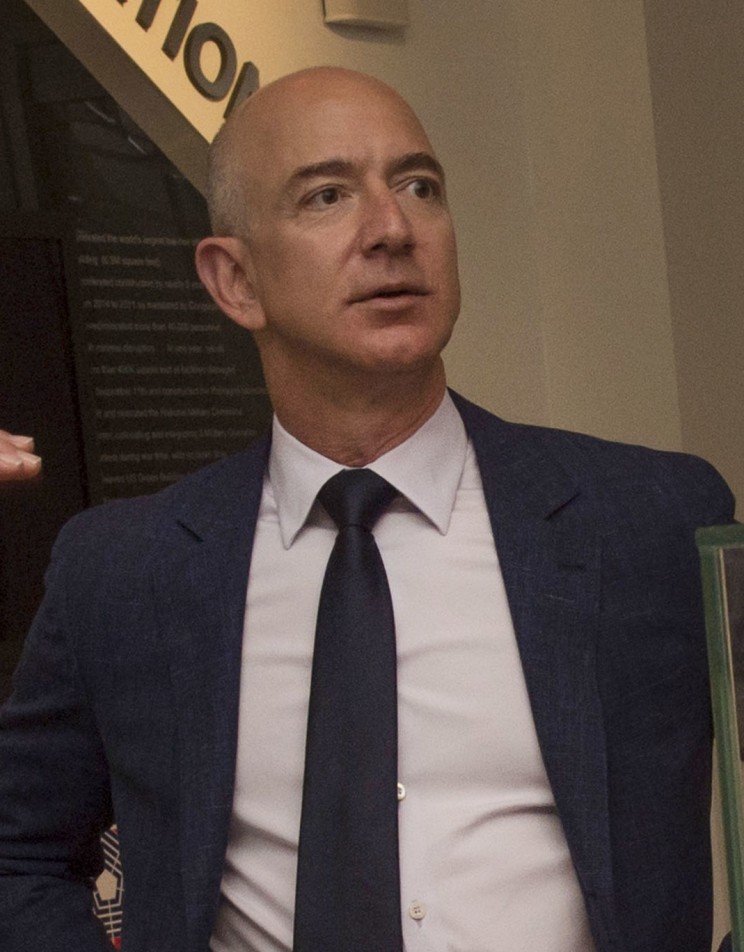

1. "Ich denke, autonome Waffen sind extrem beängstigend." - Jeff Bezos

Amazon-Chef Jeff Bezos hat deutlich gemacht, was die Gefahr der Automatisierung betrifft. Obwohl er nicht glaubt, dass die Automatisierung eine Bedrohung für menschliche Arbeitsplätze oder Leben darstellt, ist er in Bezug auf autonome Waffen weniger zuversichtlich.

Während des George W. Bush-Präsidentenforums für Führung im letzten Monat schlug Bezos vor, dass es notwendig sein würde internationale Verträge Regelung des Einsatzes autonomer Waffen. Diese Verträge würden seiner Ansicht nach den Einsatz solcher Waffen regeln und das Hacken und den Missbrauch von Technologie verhindern.

2. "Intelligente Geräte sind derzeit in der Lage zu kommunizieren, und obwohl wir glauben, dass wir sie überwachen können, haben wir keine Möglichkeit zu wissen." - Professor Kevin Warwick

Kevin Warwick, stellvertretender Vizekanzler für Forschung an der Coventry University und sogenannter "Cyborg-Professor", hat von seiner Besorgnis über die Kommunikation zwischen KI gesprochen, als 2017 zwei Bots von erstellt wurden. Facebook entwickelten ihre eigene Sprache und kommunizierten auf eine Weise, die für ihre Schöpfer nicht zu entziffern war. Die Sorgen um die KI-Kommunikation tauchten auf.

während Warwick Er wies auf die Bedeutung eines solchen Ereignisses hin und warnte andere schnell vor den weiteren Auswirkungen einer nicht überwachten Kommunikation, die sich unabhängig über den Rahmen von Wissenschaftlern und Ingenieuren hinaus entwickelt.

Facebook stimmte offensichtlich zu und beendete das Experiment, sobald sie bemerkten, dass sich die Bots auf eine Weise unterhielten, die die Menschen aus dem Kreislauf hielt.

Um die sichere Verwendung von KI zu gewährleisten, ist die Überwachung ihrer Interaktionen durch den Menschen von wesentlicher Bedeutung, und viele Wissenschaftler werden jetzt vorsichtig sein, sich weiterzuentwickeln.

3. "[AI] kann unfaire und diskriminierende Entscheidungen treffen, Vorurteile replizieren oder entwickeln und sich in hochsensiblen Umgebungen, die menschliche Interessen und Sicherheit gefährden, unergründlich und unerwartet verhalten. "- Sandra Wachter, Brent Mittelstadt und Luciano Floridi

Ein Papier von Forschern aus dem Jahr 2017 Sandra Wachter, Brent Mittelstadt und Luciano Floridi warnte, dass eines der größten Probleme in Bezug auf KI nicht die Technologie selbst ist, sondern die Vorurteile, die wir auf sie übertragen. Sie schlugen vor, dass es notwendig sein müsste, um Technologien zu schaffen, die der gesamten Menschheit angemessen dienen und sie schützen könntenfrei von den Vorurteilen, die wir als Menschen besitzen.

Sie äußerten Bedenken hinsichtlich Sicherheitsrobotern, die Vorfälle bei den Behörden melden können, und ob diese Roboter mit denselben rassistischen Vorurteilen programmiert werden, die wir in einigen Aspekten der menschlichen Strafverfolgung sehen. Um sichere Technologien zu schaffen, müssen wir zunächstmüssen unsere eigenen sozialen Missstände untersuchen, damit wir sie nicht an unsere Maschinen weitergeben.

4. "Die Entwicklung der vollständigen künstlichen Intelligenz könnte das Ende der Menschheit bedeuten." - Stephen Hawking

Der späte Stephen Hawking sprach offen und häufig darüber seine Ängste Fortschritte in der Robotik und KI-Technologien während seines gesamten Lebens. Er brachte oft seine Überzeugung zum Ausdruck, dass die KI irgendwann so weit fortgeschritten sein würde, dass sie das gesamte menschliche Leben ersetzen würde.

Es war seine Überzeugung, dass die KI irgendwann einen Punkt der Raffinesse erreichen würde, an dem sie sich selbst aktualisieren und weiterentwickeln könnte ohne menschliche Eingriffe Obwohl wir weit von Systemen entfernt sind, die diese Intelligenzstufe verwalten können, sollten Ingenieure, die die Technologien von morgen entwickeln, eine Überlegung wert sein.

5. " KI ist ein grundlegendes Risiko für die Existenz der menschlichen Zivilisation in einer Weise, wie es Autounfälle, Flugzeugabstürze, fehlerhafte Drogen oder schlechtes Essen nicht waren. "- Elon Musk

Während Elon Musk unbestreitbar an der Spitze vieler innovativer Technologien steht, heißt das nicht, dass er keine hat seine eigenen Ängste über die Fortschritte der KI und der autonomen Technologie. Tatsächlich glaubt er, dass die KI eine präsentieren könnte sehr reale Bedrohung zum weiteren Überleben der Menschheit.

Noch im letzten Monat warnte er, dass astronomische Fortschritte in der KI dazu führen könnten, dass Menschen in Zukunft von Maschinen versklavt werden. In der Dokumentation Vertrauen Sie diesem Computer? Musk ging sogar so weit zu sagen, dass er glaubte, dass in den nächsten fünf Jahren superintelligente Maschinen auftauchen werden. Hoffentlich werden die Bedenken von Musk und anderen ausgeräumt, und wir müssen uns keine Sorgen um Skynet machenSituationen jederzeit bald.

6. " Ich mache mir am meisten Sorgen nicht um intelligente KI, sondern um dumme KI. "- Toby Walsh

Letztes Jahr war Professor für KI an der Universität von New South Wales Tony Walsh Unterschreiben Sie eine Petition an die UN, in der Sie a Verbot von "Killerrobotern". Die Petition wurde auch von Elon Musk unterzeichnet. Mustafa Suleyman von Googles DeepMind und andere Wissenschaftler und Akademiker aus der ganzen Welt.

Trotz seiner Unterstützung der Petition Walsh hat klargestellt, dass seine wahre Angst nicht vor einer superintelligenten KI besteht, sondern vor einer "dummen KI", die ohne Gewissen oder Berücksichtigung von Konsequenzen eingesetzt wird.

Er glaubt, dass wir, wenn wir unseren Wettlauf um bessere Robotik und KI fortsetzen wollen, unbedingt alle Eventualitäten berücksichtigen und entsprechend planen müssen, um die Sicherheit der Menschen zu gewährleisten.

7. " Es ist wichtig, dass wir transparent über die von uns verwendeten Trainingsdaten sind und nach versteckten Verzerrungen suchen, sonst bauen wir voreingenommene Systeme auf. "- John Giannandrea

Eine weitere Expertenwarnung vor den Auswirkungen menschlicher Vorurteile auf die Technologie von morgen ist die von Google. John Giannandrea . Er gehört nur zu einer stetig wachsenden Fraktion von Wissenschaftlern, Akademikern und Ingenieuren, die Angst vor den Vorurteilen haben, die wir in unsere Technologie programmieren.

Insbesondere fordert Giannandrea vollständige Transparenz bei intelligenten Technologien für medizinische Entscheidungen. Er warnt die Menschen davor, intelligenten Blackbox-Technologien zu vertrauen, ohne ihre Funktionsweise oder die dahinter stehenden Deep-Learning-Systeme vollständig offenzulegen.

8. " „Das Problem ist nicht das Bewusstsein, sondern die Kompetenz. Sie stellen Maschinen her, die unglaublich kompetent sind, um Ziele zu erreichen, und die Unfälle verursachen, wenn sie versuchen, diese Ziele zu erreichen.“ - Stuart Russell

stellvertretender Vorsitzender des Rates des Weltwirtschaftsforums für Robotik und künstliche Intelligenz Stuart Russell, ist der Ansicht, dass eines der größten Probleme, die wir in Bezug auf KI und autonome Technologien lösen müssen, darin besteht, wie zielorientiert sie sind und was sie tun können, um dieses Ziel zu erreichen.

2016 stellte er das Problem am Beispiel eines autonomen Autos, das an einer roten Ampel festsitzt. Wenn sich das Auto in das Verkehrssystem einhacken und die Ampel grün färben kann, um sein Ziel zu erreichen, könnte es möglicherweise Leben kostenRisiko.

Für Russell und viele andere reicht es nicht aus, nur sicherzustellen, dass Roboter Menschenleben direkt schützen - wir müssen ihnen beibringen, Leben auch indirekt zu schützen. Gegenwärtig hat die strikte Zielorientierung der Programmierung eine Vielzahl von Blindspots.Dies könnte den Weg für Risiken für Menschenleben ebnen, wenn es nicht überprüft wird.

9. " Unsere Forschung zeigt den Beweis, dass auch nichtmilitärische Roboter mit Waffen bewaffnet werden können, um Schaden zu verursachen. "- Cesar Cerrudo und Lucas Apa

Forscher des Cybersicherheitsunternehmens IOActive warnten die Hersteller von Heimsicherheitstechnologien im vergangenen Jahr vor den Schwachstellen in ihren Systemen. Die Forscher, Cesar Cerrudo und Lucas Apa ging so weit, darauf hinzuweisen, dass vermeintlich harmlose Roboter in der Wohnung von bewaffnet werden könnten Hacker .

Sie fordern eine Erhöhung der Sicherheit in Heimrobotik und KIs, bevor sie alltäglich werden. Andernfalls könnten sich Häuser auf der ganzen Welt für Angriffe anfällig machen. Das Problem betrifft jedoch nicht nur Häuser. Industrieroboter in Fabriken haben diesEs wurde auch festgestellt, dass es anfällig für Hacking ist, was bedeutet, dass Produktionslinien und die Qualität ihrer Ausgaben stark beeinträchtigt werden können.

10. "A Fortgeschrittene Optimierungstechniken und vorhersehbare Muster im Verhalten automatisierter Handelsstrategien könnten von Insidern oder Cyberkriminellen zur Manipulation der Marktpreise verwendet werden. ”- Mark Carney

Eine Branche, die normalerweise nicht mit Robotern verbunden ist, ist der Finanzsektor, aber führende Persönlichkeiten des Finanzsektors äußern sich jetzt zu ihren Befürchtungen hinsichtlich der Automatisierung. Gouverneur der Bank of England und Vorsitzender des Financial Stability Board. Mark Carney, hat gewarnt, dass die Automatisierung im Finanzsektor es Hackern ermöglichen könnte, die Wirtschaft zu manipulieren.

Es wird geschätzt, dass bis 2025 230.000 Arbeitnehmer in globalen Finanzunternehmen ihren Arbeitsplatz an AI Carney und den FSB verlieren werden. Sie warnen jedoch davor, dass das globale Finanzsystem in Abhängigkeit von neuen Technologien in diesem Ausmaß anfällig für Cyberangriffe sein könnte.

11. " Es ist wirklich schlimm, wenn die Menschen insgesamt mehr Angst vor Innovationen haben als vor Begeisterung. "- Bill Gates

Microsoft-Gründer Bill Gates scheint die Position einzunehmen, dass wir nichts zu befürchten haben, als uns selbst zu fürchten. Obwohl Gates vielen Bedenken von Elon Musk in Bezug auf Roboter und KI zugestimmt hat, hat er auch seine Meinung geäußert, dass die Menschen mit Begeisterung an technologische Fortschritte herangehen müssen, keine völlige Angst.

Während Gates seine Befürchtungen zugibt Superintelligenz er scheint zu glauben, dass die Menschheit sich keine Sorgen machen muss, wenn wir entsprechend planen und diese Ängste im Voraus angehen.

12. „Katastrophale Verzerrung der Wirtschaft durch künstliche Intelligenz, um Geld für ihre Besitzer zu verdienen.“ - Dr. Andras Kornai und Dr. Daniel Berleant

Letztes Jahr TechEmergence führte eine Umfrage unter führenden Forschern und Wissenschaftlern auf dem Gebiet der Roboter und KI durch, um herauszufinden, was ihrer Meinung nach die größten Befürchtungen waren, die der Öffentlichkeit bewusst sein sollten. Die Ärzte Andras Kornai und Daniel Berleant wiesen beide auf Schwachstellen im Finanzsektor hinals berechtigte Sorge, die von vielen nicht anerkannt wird.

Kornai befürchtete, dass Finanzalgorithmen nicht die Interessen der Menschen berücksichtigen, da sie stattdessen so programmiert sind, dass sie den Gewinn um jeden Preis schützen und steigern. Berleant antwortete ähnlich und befürchtete, dass KI ausgenutzt werden könnte, um den Wohlstand einiger weniger Privilegierter zu erhöhenauf Kosten der Vielen.

13. " Wenn wir uns nicht mit den Herausforderungen der Automatisierung befassen, könnte die soziale Mobilität weiter zurückgedrängt werden. "- Sir Peter Lampl

Kornai und Berleant sind nicht die einzigen, die darauf hingewiesen haben, wie Fortschritte in der Technologie die Haves weiter von den Have-Nots trennen könnten. Sir Peter Lampl , von Sutton Trust und die Education Endowment Foundation haben darauf hingewiesen, dass die Automatisierung mehr als jede andere Gruppe eine Bedrohung für die Arbeiter der Arbeiterklasse darstellt.

Er glaubt, dass die Automatisierung die Kluft zwischen der oberen und der unteren Klasse vergrößern könnte, da die manuelle Arbeit von Maschinen übernommen wird, die eine ganze Klasse ohne die erforderlichen Werkzeuge verlassen, um ihren Lebensunterhalt zu verdienen. Er fordert größere Investitionen in "Soft Skills" wie Kommunikationdas wird die menschliche Arbeit von ihren Roboterkonkurrenten abheben und die menschlichen Arbeiter wertvoller machen.

14. "A Fortschritte in der künstlichen Intelligenz werden bestimmte Arten von sozialen Problemen verursachen oder sie verschlimmern. "- Jerry Kaplan

Bestsellerautor und KI-Experte Jerry Kaplan glaubt, dass Fortschritte in der Technologie uns zwingen werden, bereits bestehende Probleme in unserer Gesellschaft zu untersuchen, und das aus gutem Grund. Wenn Technologie verantwortungsbewusst und sicher eingesetzt werden soll, müssen alle Vorkehrungen getroffen werden, um zu verhindern, dass sie von diesen genutzt werdenanderen Schaden zufügen wollen.

In dieser Hinsicht Kaplan betrachtet KI und Roboter nicht als Bedrohung an und für sich, sondern als potenziell gefährliches Werkzeug, das von Kriminellen und anderen eingesetzt werden könnte. Die einzige Möglichkeit, dies zu verhindern, besteht laut Kaplan darin, die zugrunde liegenden Probleme in unserer Gesellschaft anzugehen.

15. " Je leistungsfähiger der Roboter ist, desto höher ist der Einsatz. Wenn Roboter in Zukunft Autonomie haben ... ist das ein Rezept für eine Katastrophe. "- Selmer Bringsjord

Selmer Bringsjord , ein Wissenschaftler aus der Das Rensselaer Polytechnic Institute ist sowohl besorgt über die Fähigkeit einer Maschine, Schaden anzurichten, als auch über die Fähigkeit des Menschen, eine Maschine so zu programmieren, dass sie Schaden anrichtet. Es ist sicherlich ein schwieriges Rätsel.

Wie von anderen Experten in diesem Artikel zum Ausdruck gebracht, ist es wichtig, sich vor autonomen Maschinen zu schützen, die Menschen bei ihren Versuchen, ihre Ziele zu erreichen, versehentlich Schaden zufügen. Ebenso müssen wir feststellen, dass Maschinen keine Schwachstellen aufweisen, die ausgenutzt oder beschädigt werden könnenBis dahin ist es noch ein langer Weg, bis all diese Probleme angegangen und ausgeräumt sind. Bis dahin ist es für Führungskräfte in den Bereichen Forschung, Wissenschaft und Technologie wichtig, weiterhin über ihre Bedenken zu sprechen und Wege zur Verbesserung künftiger Technologien vorzuschlagen.