In den letzten Monaten haben KI-Tools ernsthafte Bedenken hinsichtlich der Art und Weise aufgeworfen, wie sie zur Manipulation der Öffentlichkeit eingesetzt wurden und werden können.

Was ist die Lösung? Laut Forschern von Harvard und MIT gibt es eine bessere Lösung, als nur Skynet vom Stromnetz zu trennen.

Der beste Weg, um KI zu schlagen, ist tatsächlich mit KI, sagen sie.

KI gegen KI

KI kann verwendet werden, um gefälschte Nachrichten zu verbreiten, gefälschte Bewertungen zu schreiben und eine vorgetäuschte Menge von Social-Media-Nutzern zu erstellen, die darauf abzielen, Kommentarbereiche mit bestimmten Agenden zu bombardieren.

Laut MIT-Forschern kann es jetzt jedoch auch verwendet werden, um gefälschten künstlich erzeugten Text zu erkennen - anscheinend braucht man einen, um einen zu kennen.

Obwohl die Technologie für Fehlinformationen Fortschritte macht ein besorgniserregend schnelles Tempo Das gleiche breite Toolset kann dankenswerterweise verwendet werden, um diese Art von Fehlinformationen abzufangen. Bei gefälschten Nachrichten, Deepfakes und Twitter-Bots werden die Tage möglicherweise durch die Technologie gezählt, die sie erstellt hat.

Erkennen statistischer Textmuster

Forscher der Harvard University und des MIT-IBM Watson AI Lab haben kürzlich ein neues Tool entwickelt, mit dem von AI generierter Text erkannt werden kann.

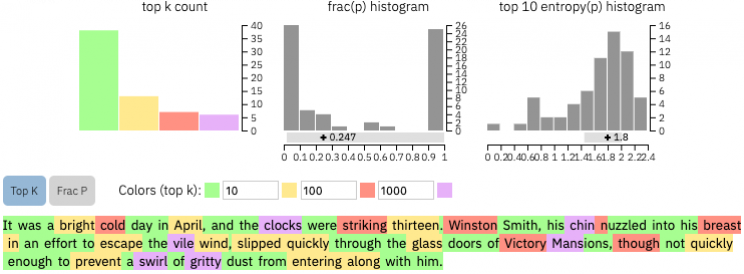

Das Werkzeug namens GLTR Giant Language Model Test Room nutzt die Tatsache, dass AI-Textgeneratoren ziemlich vorhersehbare statistische Muster im Text verwenden.

Obwohl diese Muster für einen durchschnittlichen Leser möglicherweise nicht leicht zu erkennen sind, scheint es, dass ein Algorithmus ziemlich gute Arbeit leisten kann. Das KI-Tool kann im Wesentlichen erkennen, ob der Text zu vorhersehbar ist, um von a geschrieben zu werdenMensch.

Wie funktioniert es?

GLTR testet die Vorhersagbarkeit in Texten anhand der statistischen Wahrscheinlichkeit, dass ein Wort in einem Satz nach dem anderen ausgewählt wird.

Wir liefen die Eröffnungspassage von1984 durch das Tool, um George Orwell auf die Probe zu stellen - und um zu beweisen, dass er nicht wirklich eine KI war, die aus der Zukunft in die Vergangenheit geschickt wurde. Werbung

Grüne Wörter sind dagegen am vorhersehbarsten, während gelbe und rote dazwischen liegen.

Natürlich können wir uns eine Zukunft vorstellen, in der textgenerierende maschinelle Lernwerkzeuge auf diese lila Wörter trainiert werden, um GLTR zu täuschen, indem sie menschlicher wirken - wir hoffen, dass die GLTR-Forscher mithalten können.

KI gegen Menschen?

Um die GLTR zu testen, baten die Forscher die Harvard-Schüler, AI-generierten Text zu identifizieren - zuerst mit dem Tool und dann ohne.

Die Schüler haben nur die Hälfte aller gefälschten Texte erfolgreich selbst entdeckt. Mit dem Tool haben sie dagegen 72% entdeckt.

Während das Experiment Menschen gegen KI austauschte - vielleicht eine unheimliche Vorahnung der Zukunft - sagt einer der Forscher, dass ihr letztendliches Ziel anders ist :

Werbung

eine Veröffentlichung ungefähr GLTR. Wenn Sie das neue Tool selbst ausprobieren möchten, finden Sie es

hier . A Papier Einzelheiten zu den Experimenten und dem neuen Tool wurde kürzlich von den Forschern veröffentlicht. In Zukunft könnten große politische Unruhen mit glaubwürdigen, gefälschten Videos von Weltführern verursacht werden, und KI-generierter Text könnte verwendet werden, um Fehlinformationen massenhaft zu verbreiten. Zum Glück könnte dieselbe Technologie auch eine Lösung für das Problem bieten.

Werbung